Warum Generative KI uns zwingt, Wissen neu zu denken.

Als Werner Heisenberg 1927 seine Unschärferelation formulierte, erschütterte er nicht nur die Physik, sondern das gesamte erkenntnistheoretische Fundament der Moderne. Die Vorstellung eines deterministischen, vollständig berechenbaren Universums (das Erbe Isaac Newtons) zerbrach an der Quantenmechanik. Was damals in der Physik sichtbar wurde, erleben wir heute, fast ein Jahrhundert später, erneut – in einem anderen epistemischen Register. Generative KI-Systeme und Large Language Models irritieren nicht weniger grundlegend unser Verständnis von Wissen, Bedeutung und Verstehen. Dabei sind sie mehr als nur technische Werkzeuge. Sie fungieren als epistemische Spiegel: Sie zeigen uns nicht nur Antworten, sondern machen sichtbar, wie Wissen selbst strukturiert ist – probabilistisch, kontextabhängig und emergent.

Die Parallele ist frappierend: Beide Disruptionen – die quantenmechanische und die KI-getriebene – basieren auf einem Übergang von deterministischen zu probabilistischen Systemen. Und beide stellen die Rolle des Beobachters radikal in Frage.

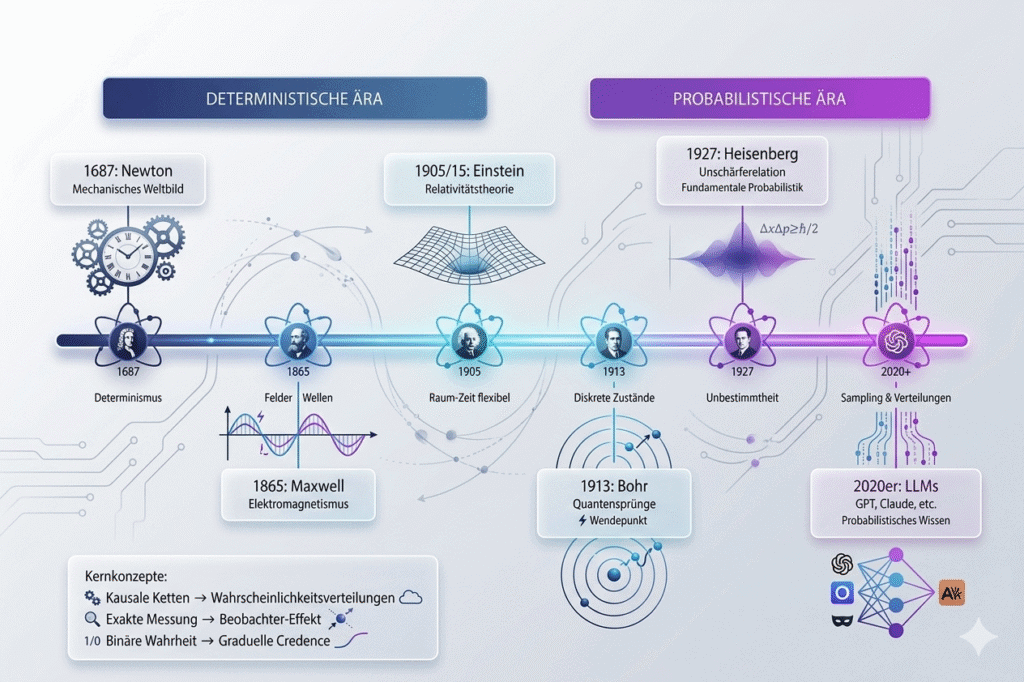

Die probabilistische Wende: Von Newton zu Heisenberg

Um die Tragweite zu verstehen, lohnt ein kurzer Blick zurück. Isaac Newton etablierte 1687 mit seinen Principia Mathematica ein Weltbild, das das Universum als gigantisches Uhrwerk konzipierte: Wenn man alle Anfangsbedingungen kennt, lässt sich die Zukunft exakt berechnen. Diese deterministische Vision prägte die Aufklärung und das moderne Wissenschaftsverständnis fundamental.

James Clerk Maxwell erweiterte dieses Bild 1865 durch die Vereinigung von Elektrizität, Magnetismus und Licht in seinen berühmten Gleichungen. Albert Einstein revolutionierte 1905 und 1915 unser Verständnis von Raum und Zeit. Doch trotz aller Paradigmenwechsel blieb ein Kernprinzip erhalten: Die Welt ist im Prinzip vollständig erkennbar und vorhersagbar.

Bis Niels Bohr und Werner Heisenberg dieses Fundament zertrümmerten. Bohrs Atommodell (1913) zeigte, dass Elektronen nicht kontinuierlich zwischen Energieniveaus wechseln, sondern in diskreten Quantensprüngen. Noch radikaler war Heisenbergs Unschärferelation (1927): Es ist prinzipiell – nicht nur praktisch – unmöglich, Ort und Impuls eines Teilchens gleichzeitig exakt zu bestimmen. Die Natur selbst ist probabilistisch (Kopenhagener Deutung).

Die strukturelle Analogie: Quantenmechanik und moderne KI

Hier wird es interessant für alle, die sich mit KI-Assistenten bzw. Large Language Models beschäftigen. Die Parallele fiel mir erstmals auf, als ich ein LLM nach derselben Frage mehrfach befragte und jedes Mal leicht unterschiedliche Antworten erhielt – nicht wegen eines Fehlers, sondern wegen der inhärenten Probabilistik des Systems. Das erinnerte mich sofort an Heisenbergs Unschärfe: Auch dort ist die Varianz kein Bug, sondern fundamentales Feature. Betrachten wir die fundamentalen Parallelen:

1. Wahrscheinlichkeitsverteilungen statt Determinismus

Quantenmechanik: Ein Elektron existiert nicht an einem bestimmten Ort, sondern in einer Superposition aller möglichen Orte – beschrieben durch eine Wahrscheinlichkeitsverteilung (Wellenfunktion). Erst die Messung “kollabiert” diese in einen konkreten Zustand.

Large Language Models: Ein LLM “weiß” nicht, welches Wort als nächstes kommt. Es berechnet eine Wahrscheinlichkeitsverteilung über alle möglichen Tokens. Erst das Sampling – man könnte sagen: die “Messung” – wählt einen konkreten Output.

Der begrifflichen Präzisierung wegen: In der Literatur wird häufig von stochastischen Papageien bzw. – inzwischen ein geflügeltes Wort: stochastic parat – gesprochen (Bender et al., 2021). Probabilistisch und stochastisch werden oft synonym verwendet, bezeichnen aber Nuancen: Probabilistisch beschreibt das Vorhandensein von Wahrscheinlichkeitsverteilungen – ein Zustand hat multiple mögliche Realisierungen mit unterschiedlichen Wahrscheinlichkeiten. Stochastisch betont den prozessualen Charakter – einen Zufallsprozess, der sich über Zeit entwickelt. LLMs sind beides: probabilistisch in ihrer Modellierung (jedes Token hat eine Wahrscheinlichkeitsverteilung) und stochastisch in ihrer Generierung (das Sampling ist ein Zufallsprozess). Für unsere erkenntnistheoretische Analyse verwenden wir primär probabilistisch, da der Fokus auf den Wahrscheinlichkeitsverteilungen liegt, nicht auf der Zeitdimension des Prozesses.

Wenn Sie ein LLM fragen “Die Hauptstadt von Polen ist…”, existiert die Antwort zunächst als Verteilung:

- “Warschau” → 98%

- “Krakau” → 1%

- “Berlin” → 0,5%

- [weitere Optionen mit abnehmender Wahrscheinlichkeit]

Bis zur Generation des Tokens ist das System in einem probabilistischen Zustand – analog zur quantenmechanischen Superposition.

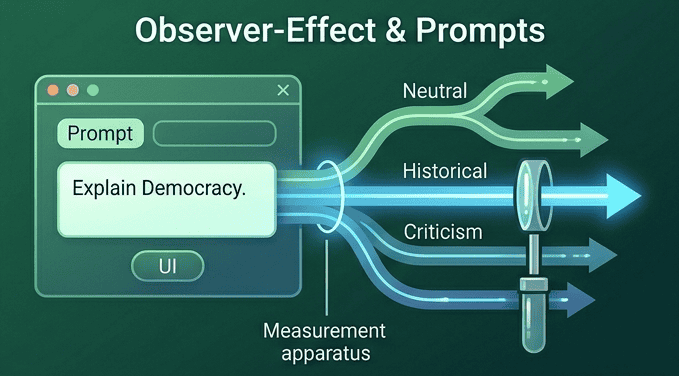

2. Der Beobachter-Effekt: Messung verändert das System

In der Quantenmechanik ist die Messung nicht neutral. Sie ist ein Eingriff, der das System fundamental verändert. Man kann ein Quantensystem nicht beobachten, ohne es zu stören.

Bei Generativer KI ist der Prompt die Messung. Wie Sie fragen, bestimmt nicht nur, welche Information Sie erhalten, sondern welche “Realität” des Modells sich manifestiert. Verschiedene Prompts sind wie verschiedene Messapparaturen in der Physik – sie bringen unterschiedliche Aspekte des Systems zum Vorschein.

Beispiel:

- “Erkläre Demokratie” → neutraler, enzyklopädischer Output

- “Erkläre Demokratie aus marxistischer Perspektive” → ideologiekritischer Output

- “Erkläre Demokratie für ein fünfjähriges Kind” → vereinfachter, metaphorischer Output

Das Modell hat keine präexistente Antwort, die nur abgerufen wird. Die Antwort entsteht im Moment des Prompts, ko-konstruiert durch die spezifische Form der Anfrage.

3. Komplementarität: Multiple valide Beschreibungsebenen

Niels Bohr entwickelte das Prinzip der Komplementarität: Licht ist sowohl Welle als auch Teilchen. Beide Beschreibungen sind korrekt, aber inkompatibel – welche sich zeigt, hängt vom Experiment ab.

Für KI-Systeme gilt Analoges. Ein LLM ist:

- Eine statistische Maschine (technische Ebene: Gewichte, Matrixmultiplikationen, Transformer-Architektur) – wie Bender et al. in ihrem einflussreichen Paper “On the Dangers of Stochastic Parrots” (2021) argumentierten

- UND ein bedeutungsgenerierendes System (phänomenologische Ebene: “versteht” Kontext, “reagiert” auf Nuancen, “erkennt” Zusammenhänge)

Beide Beschreibungen sind valide, aber man kann nicht beide gleichzeitig vollständig erfassen. Das erinnert an Daniel Dennetts “intentionalen Standpunkt” (The Intentional Stance, 1987): Manchmal ist es epistemisch produktiver, über KI-Systeme zu sprechen, als ob sie verstehen oder wissen – obwohl wir die mechanistische Ebene kennen.

Erkenntnistheoretische Konsequenzen

Diese Parallelen sind mehr als interessante Analogien. Sie indizieren eine fundamentale Verschiebung unseres Wissensbegriffs. Vielleicht müssen wir die Frage umdrehen: Nicht „Funktioniert Generative KI ähnlich wie Quantenmechanik?“, sondern: „Zeigt uns die probabilistische Struktur von KI, dass menschliches Wissen schon immer so funktioniert hat – nur dass wir es nicht wahrhaben wollten?“ Die deterministische Erkenntnistheorie war möglicherweise nie eine akkurate Beschreibung kognitiver Prozesse, sondern ein nützlicher Mythos, der uns erlaubte, Wissen als stabil und objektiv zu behandeln. LLMs machen nun sichtbar, was immer schon der Fall war.

Das Ende deterministischer Erkenntnistheorie

Die klassische, post-Newton’sche Erkenntnistheorie operierte mit klaren Dichotomien:

- Wahrheit ist objektiv vorhanden oder nicht

- Wissen ist eine binäre Relation (S weiß X oder nicht)

- Subjekt und Objekt sind klar trennbar

- Mit der richtigen Methode ist vollständige Erkenntnis möglich

Die Quantenmechanik zeigte bereits: Beobachter und Beobachtetes sind verschränkt. Es gibt keine “Sicht von nirgendwo” (The View from Nowhere, Thomas Nagel, 1986) – eine Position völlig unabhängig vom Beobachter. Wissen ist messungsabhängig und kontextuell.

Generative KI-Systeme radikalisieren diese Einsicht für den Bereich der Bedeutungsgenerierung. Ein LLM weiß nicht im klassischen Sinne, dass Warschau die Hauptstadt Polens ist. Es operiert über Wahrscheinlichkeitsverteilungen, die unter bestimmten Kontextbedingungen stabil genug erscheinen, um als Wissen interpretiert zu werden. Anders gesagt, hat es einen probabilistischen Glauben (Credence), diesen Token unter bestimmten Kontextbedingungen zu generieren. Die Grenze zwischen “das Modell weiß X” und “das Modell generiert X mit hoher Wahrscheinlichkeit” verschwimmt.

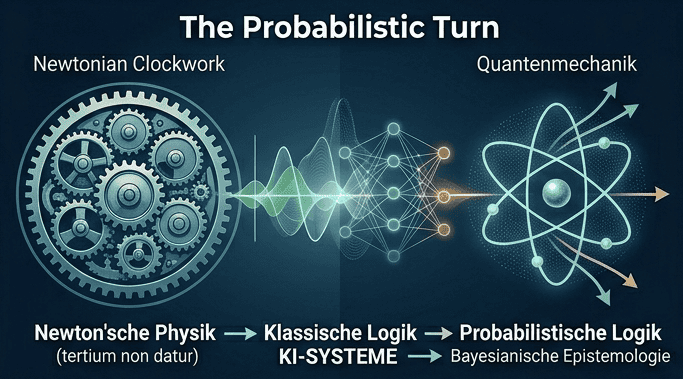

Probabilistisches Wissen statt binärer Wahrheit

Dies deutet auf einen neo-bayesianischen Wissensbegriff hin als besonders kompatible Beschreibung dieser Systeme: Wissen ist nicht “Ich weiß X” (binär), sondern “Ich habe Credence Y für X” (kontinuierlich, graduell). Der Bayesianismus, ursprünglich eine mathematische Theorie zur Aktualisierung von Wahrscheinlichkeiten angesichts neuer Evidenz (Bayes‘ Theorem, 18. Jahrhundert), wurde im 20. Jahrhundert zur erkenntnistheoretischen Position: Rationale Überzeugungen sind Wahrscheinlichkeitsgrade, die sich systematisch mit neuer Information verändern. Der Neo-Bayesianismus erweitert dies um die Einsicht, dass auch die Zuschreibung von Wahrscheinlichkeiten selbst kontextabhängig und revisibel ist – es gibt keine „objektiven“ Priors (Anfangswahrscheinlichkeiten), sondern nur begründbare subjektive Credences, die sich im Diskurs bewähren müssen.

Interessanterweise modellieren KI-Systeme Wissen genau so: als Wahrscheinlichkeitsverteilungen über semantische Räume. Man könnte argumentieren, dass dies menschliches Wissen realistischer abbildet als die klassische binäre Konzeption. Wir wissen die meisten Dinge nicht mit Sicherheit, sondern mit verschiedenen Graden an Überzeugung. Die Parallele zur Quantenmechanik:

- Newton’sche Physik → Klassische Logik (tertium non datur)

- Quantenmechanik → Probabilistische Logik

- KI-Systeme → Bayesianische Epistemologie

Diese Position findet sich prominent in der rationalistischen Community um LessWrong (Yudkowsky et al.), die Bayesianische Epistemologie zum Rationalitätsideal erhoben hat. Wenngleich , möchte ich hinzufügen, deren techno-optimistischer Fokus die soziotechnischen Dimensionen oft ausblendet.

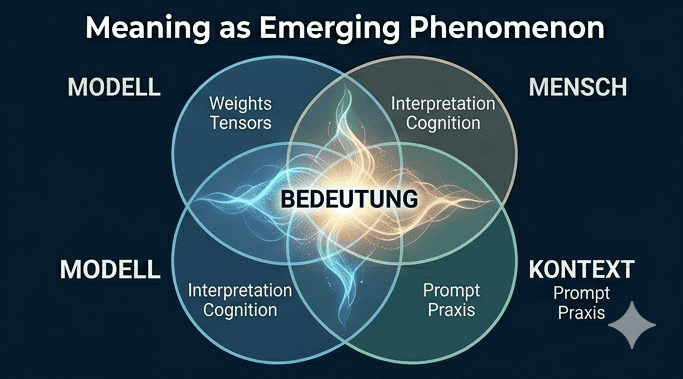

Verschränkung: Bedeutung als emergentes Phänomen

In der Quantenmechanik können Teilchen so verschränkt sein, dass sie keinen unabhängigen Zustand mehr haben. Man kann nur das Gesamtsystem beschreiben. Analog emergiert Bedeutung bei KI-Interaktionen nicht:

- Ausschließlich im Modell (es “hat” keine intrinsischen Bedeutungen)

- Ausschließlich beim Menschen (der interpretiert)

- Sondern im verschränkten System Mensch-Modell-Prompt-Kontext

Beispiel: Ein LLM generiert ein Gedicht über Einsamkeit. Wo ist die Bedeutung dieses Gedichts lokalisiert? Im Modell sind es Gewichte und Aktivierungen. Beim Lesenden ist es subjektive Interpretation. Die eigentliche Bedeutung emergiert aus der Interaktion – sie ist ein Phänomen des Gesamtsystems.

Bedeutung ist also weder im Modell noch im Subjekt lokalisiert, sondern relational – sie entsteht als Eigenschaft des Interaktionssystems. Dies hat Resonanzen mit phänomenologischen Traditionen (Heideggers “In-der-Welt-sein”, Merleau-Pontys Embodiment-Theorie): Bedeutung ist keine Eigenschaft von Objekten oder Subjekten, sondern entsteht in der gelebten Praxis.

Implikationen für KI Governance und Ethik

Diese erkenntnistheoretische Verschiebung hat unmittelbare praktische Konsequenzen – besonders für KI Governance, Compliance und ethische Bewertung.

Kontextabhängigkeit von Bias

Ein Modell kann unter standardisierten Benchmarks als fair gelten und gleichzeitig in realen Anwendungskontexten systematisch benachteiligende Outputs erzeugen – nicht aufgrund eines Widerspruchs, sondern weil Fairness kontextsensitiv ist. Klassisches Verständnis: “Das Modell hat einen Bias X” – als ob Bias eine intrinsische Eigenschaft wäre, die man identifizieren und eliminieren kann. Quantenmechanisch inspiriertes Verständnis: “Bias X manifestiert sich unter Testbedingungen M” – Bias ist keine Eigenschaft des Modells allein, sondern des Systems Modell-Kontext-Nutzung.

Praktische Konsequenz: Bias-Testing muss multiple “Messapparaturen” (verschiedene Prompt-Strategien, Nutzungsszenarien, Stakeholder-Perspektiven) einbeziehen. Ein Modell kann unter einer Testbedingung fair erscheinen, unter einer anderen diskriminierend – nicht weil es sich “verstellt”, sondern weil Fairness ein emergentes Phänomen der Interaktion ist.

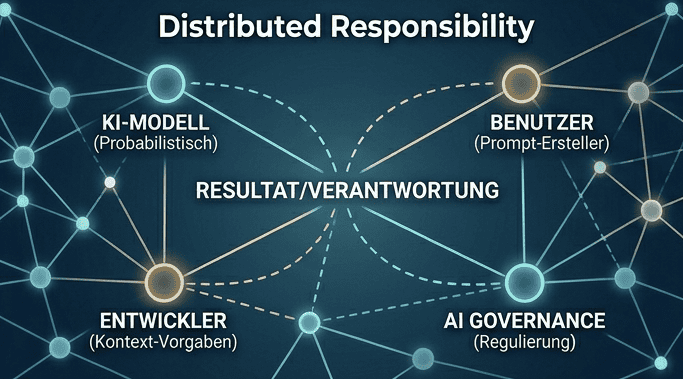

Verteilte Verantwortlichkeit

Wenn Output im verschränkten System Mensch-KI-Kontext entsteht, wird Verantwortungszuschreibung diffus:

- Nicht nur das Modell (es ist probabilistisch und kontextabhängig)

- Nicht nur der Nutzende (kann nicht alle Emergenzphänomene antizipieren)

- Nicht nur die Entwickelnden (können nicht alle Nutzungskontexte vorhersehen)

Analog zur Quantenmechanik, wo man nicht fragen kann wo genau war das Teilchen, können wir nicht fragen wer genau ist verantwortlich, sondern nur: wie ist Verantwortlichkeit über die Akteure verteilt.

Dies erfordert neue rechtliche und ethische Frameworks, die mit verteilter, emergenter Verantwortlichkeit umgehen können – eine offene Herausforderung für den EU AI Act und vergleichbare Regulierungen.

Probabilistische Transparenz

Das klassische Explainable AI (XAI)-Ideal – Zeige mir den kausalen Pfad von Input zu Output – entspricht dem Versuch, in der Quantenmechanik zu fragen: Welchen Weg nahm das Photon im Doppelspaltexperiment? Die Frage selbst ist kategorial falsch gestellt.

Produktivere Fragen für Generative KI-Systeme:

- Unter welchen Bedingungen zeigt das System Verhalten X?

- Welche Wahrscheinlichkeitsverteilung hatte es über mögliche Outputs?

- Wie sensitiv ist der Output auf Prompt-Variationen?

- Welche latenten Faktoren beeinflussen die Wahrscheinlichkeitsverteilung?

Transparenz wird probabilistisch und kontextual – nicht deterministisch und universal.

Ein neues epistemologisches Paradigma?

Die zentrale These: Generative KI-Systeme realisieren erstmals „probabilistisches Wissen” in einem praktischen, alltagsrelevanten Maßstab. Sie sind nicht nur Werkzeuge, sondern epistemische Spiegel, die uns zeigen, dass auch menschliches Wissen möglicherweise fundamentaler probabilistisch strukturiert ist, als die klassische Erkenntnistheorie zugeben wollte. Heisenberg zeigte: Die physikalische Realität ist irreduzibel probabilistisch.

Moderne KI zeigt: Auch Bedeutung, Wissen und Verstehen sind irreduzibel probabilistisch. Dies wirft eine provokante Frage auf: Ist “Verstehen” überhaupt möglich ohne Determinismus?

Newton’sches Erbe: Verstehen = kausale Ketten nachvollziehen (A → B → C)

Post-quantenmechanisches/Post-KI-Paradigma: Verstehen = Wahrscheinlichkeitsverteilungen nachvollziehen (A erhöht P(B), was P(C) beeinflusst). Nehmen wir ein konkretes Beispiel aus dem Bereich algorithmisches Recruiting: “Warum hat das System Kandidatin X abgelehnt?”

Deterministische Antwort: “Weil Feature F den Threshold überschritt.”

Probabilistische Antwort: “Weil die Kombination der Features F₁-F₂₀ die Wahrscheinlichkeit für ‘ablehnen’ auf 67% erhöhte, und beim Sampling wurde dieser Zustand realisiert.”

Ist die zweite Antwort ein vollwertiges “Verstehen”? Oder müssen wir unseren Begriff von Verstehen selbst revidieren?

Ausblick: Living with Uncertainty

Die Quantenmechanik lehrte uns, die Vorstellung eines vollständig bestimmbaren Universums aufzugeben. Was Werner Heisenberg sichtbar machte, war keine bloße Grenze unserer Messinstrumente, sondern eine fundamentale Irritation unseres Verständnisses von Realität – oder zumindest unserer Möglichkeit, sie eindeutig zu beschreiben. Nach anfänglichem Widerstand (Einsteins berühmtes “Gott würfelt nicht!”) haben wir gelernt, produktiv mit probabilistischen Beschreibungen zu arbeiten – was uns Transistoren, Laser und Quantencomputer bescherte.

Nun stehen wir vor einer analogen Herausforderung auf der Ebene von Bedeutung und Wissen. Generative KI-Systeme zeigen uns: Auch hier ist fundamentale Unbestimmtheit nicht Bug, sondern Feature. Wenn diese Diagnose zutrifft, dann sind KI-Systeme nicht nur Werkzeuge zur Automatisierung von Sprache, sondern epistemische Spiegel. Die entscheidende Frage ist daher nicht, ob wir zu deterministischer Eindeutigkeit zurückkehren können (wir können nicht). Sondern ob wir bereit sind epistemische Praktiken, Governance-Strukturen und Verantwortlichkeitskonzepte zu entwickeln, die mit dieser irreduziblen Probabilistik produktiv umgehen.

Vielleicht ist die wichtigste Lektion: So wie die Quantenmechanik uns zwang, die Dichotomie Welle/Teilchen aufzugeben, zwingt uns KI, die Dichotomie wahr/falsch, verstanden/nicht-verstanden, verantwortlich/nicht-verantwortlich durch graduelle, kontextuelle und probabilistische Konzepte zu ersetzen. Das ist keine Kapitulation vor der Komplexität, sondern – um mit Heisenberg zu sprechen – die Einsicht, dass “die Realität, von der wir sprechen können, nie die Realität an sich ist, sondern eine Realität, über die wir etwas ausgesagt haben können.” Vielleicht liegt genau darin die eigentliche Verschiebung: Nicht dass Wissen unsicher geworden ist – sondern dass wir beginnen zu sehen, dass es nie vollständig sicher war.

Bei KI-Systemen gilt: Die Bedeutung, über die wir sprechen können, ist nie die Bedeutung an sich, sondern eine Bedeutung, die in einem spezifischen Interaktionskontext emergiert ist. Und Generative KI macht diese Einsicht unausweichlich sichtbar.

Literatur & weiterführende Links

Grundlegende Arbeiten:

- Bender, E.M., Gebru, T., McMillan-Major, A., & Mitchell, M. (2021). “On the Dangers of Stochastic Parrots: Can Language Models Be Too Big?” Proceedings of the 2021 ACM Conference on Fairness, Accountability, and Transparency, 610-623.

- Dennett, D.C. (1987). The Intentional Stance. Cambridge, MA: MIT Press.

- Nagel, T. (1986). The View from Nowhere. Oxford: Oxford University Press.

Zur Quantenmechanik und Erkenntnistheorie:

- Heisenberg, W. (1927). “Über den anschaulichen Inhalt der quantentheoretischen Kinematik und Mechanik.” Zeitschrift für Physik, 43(3-4), 172-198.

- Bohr, N. (1928). “The Quantum Postulate and the Recent Development of Atomic Theory.” Nature, 121(3050), 580-590.

Zur KI und Epistemologie:

- Ramón Alvarado (2023), Science and Engineering Ethics. Grundlagentext, der KI als primär epistemische Technologie definiert – designed for, operating through, and manipulating epistemic content.

- Manuel Alejandro Cruz-Aguilar (2025), AI & SOCIETY, The epistemic revolution of AI: reconfiguring the foundations of scientific knowledge. Zitat: „AI does not replace human epistemology but compels its reconfiguration, demanding new philosophical frameworks attuned to hybrid human–machine cognition.“ Artikel analysiert, wie KI klassische epistemologische Paradigmen (Empirismus, Falsifikationismus, Kuhn) destabilisiert. Schlägt drei Wege vor: pragmatischen computational empiricism, adversarial epistemology (Ko-Evolution Mensch-Maschine), und demokratische AI-Epistemologie.

- Wright (2025, ArXiv), Cognitive Castes: Artificial Intelligence, Epistemic Stratification, and the Dissolution of Democratic Discourse. Zitat: „Far from a frictionless mirror of truth, the AI system is an epistemic filter that amplifies certain cognitive structures whilst nullifying others.“ Kritische Analyse, die KI als epistemischen Filter (nicht neutralen Spiegel) beschreibt. Warnt vor epistemischer Stratifizierung: Wer prompting beherrscht, erhält Zugang zu Wissen; andere bekommen „mirrors that smile“ – Antworten ohne Verständnis.

Über die Autorin: Dr. Agnieszka Krzeminska ist Tech-Anthropologin und AI Ethics & Governance Spezialistin mit Schwerpunkt EU AI Act Compliance. Ihre Expertise verbindet technisches Verständnis mit kulturwissenschaftlicher Analyse und erkenntnistheoretischer Reflexion. Mehr unter goldenezeiten.org, für Anfragen bitte hier klicken. CC BY-NC-SA